নির্বাচনের আগে সামাজিক মাধ্যমে রাজনৈতিক দলের সমর্থনে এআই দিয়ে বানানো ভিডিওর ছড়াছড়ি

- প্রকাশিত 8 ফেব্রুয়ারি 2026, 13:52

- 2 এক্স মিনিটে পড়ুন

- লেখক: Rasheek MUJIB, এএফপি বাংলাদেশ

শেখ হাসিনার সরকার পতনের পর বাংলাদেশে প্রথম জাতীয় নির্বাচন হতে যাচ্ছে। এ সময় মানুষজন কেন দেশের বৃহত্তম ইসলামপন্থী দলকে ভোট দেবেন তা ব্যাখ্যা করে কৃত্রিম বুদ্ধিমত্তা (এআই) দিয়ে বানানো ক্লিপ সামাজিক যোগাযোগমাধ্যমে ছড়ানো হচ্ছে। তবে ভিডিওগুলো গুগলের এআই টুল ব্যবহার করে তৈরি করা হয়েছে। ভিডিওগুলো এমন একটি অ্যাকাউন্ট থেকে ছড়ানো হচ্ছে, যেটি জামায়াতে ইসলামীর সমর্থনে নিয়মিত এই ধরণের কন্টেন্ট প্রকাশ করে।

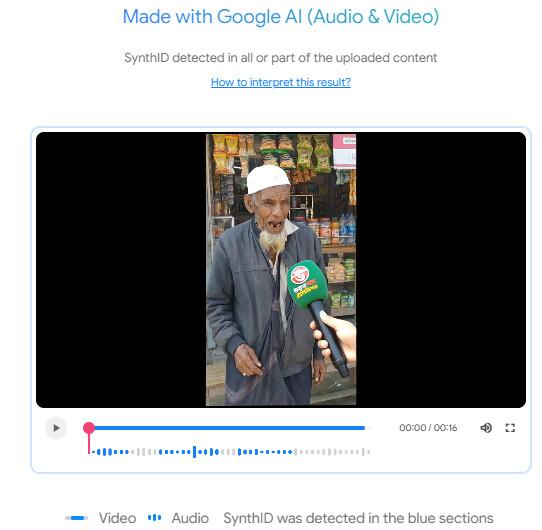

২৪ জানুয়ারি ২০২৬ তারিখে প্রকাশিত এক ফেসবুক পোস্টের ক্যাপশনে বলা হয়, “জামাতকে ভোট দিলে আমাকে আর ভিক্ষা করতে হবে না। কেন এই কথা বললেন এই ভিক্ষুক।”

ভিডিওটি ২৯,০০০ বার শেয়ার করা হয়েছে। সেখানে একজন বৃদ্ধ লোককে বলতে দেখা যায় যে, তিনি জামায়াতকে ভোট দিবেন।

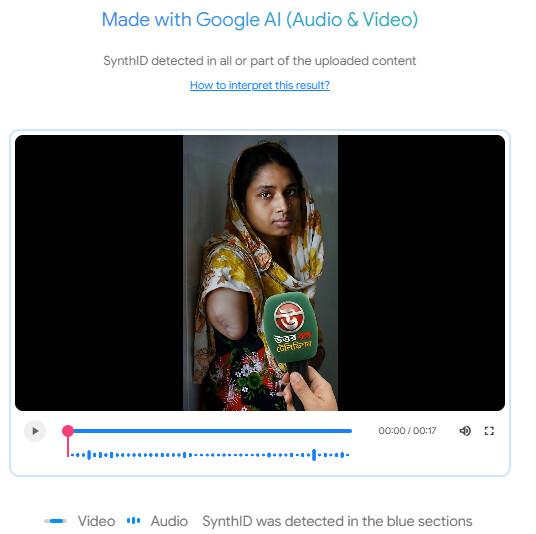

১১ জানুয়ারি ছড়ানো অন্য একটি ভিডিওতে এক হাত বিচ্ছিন্ন একজন নারীকে দেখা যায়।

ভিডিওতে ওই নারীকে বলতে শোনা যায়, “আমি এই ঘুষখোর বিএনপিকে ভোট দিবো না, ভোট যদি দিতেই হয়, জামাতকে দিবো।”

একই দাবিতে ভিডিওগুলো অন্যত্র ফেসবুকে এবং ইনস্টাগ্রামে ছড়ানো হয়েছে।

কিন্তু ভিডিওগুলো কৃত্তিম বুদ্ধিমত্তা দিয়ে তৈরি।

এআই দিয়ে তৈরি

কৃত্রিম বুদ্ধিমত্তা দিয়ে তৈরি কন্টেন্ট শনাক্ত করার জন্য গুগলের ডিটেক্টর টুল সিন্থআইডিতে অনলাইনে ছড়ানো ভিডিওগুলোর স্ক্রিনশট বিশ্লেষণ করে দেখা গেছে যে, প্রথম ক্লিপটি গুগলের এআই টুলের দিয়ে তৈরি করা হয়েছে(আর্কাইভ লিংক)।

ফুটেজটির আরও বিশ্লেষণে একাধিক দৃশ্যগত অসঙ্গতি পাওয়া যায়, যেগুলো ভিডিওটিকে কৃত্রিম বুদ্ধিমত্তা দিয়ে তৈরির ইঙ্গিত দেয়।

ভিডিওটির পটভূমিতে দৃশ্যমান দোকানের খাদ্যদ্রব্যগুলোর লেবেল ও নাম বিকৃত এবং দুর্বোধ্য দেখা যায়।

অসত্যভাবে ছড়ানো দ্বিতীয় ভিডিওটির কিফ্রেম ব্যবহার করে গুগলে রিভার্স ইমেজ সার্চে দেখা যায় যে, ২১ জুন ২০১৩ তারিখে প্রকাশিত এনবিসি নিউজের একটি প্রতিবেদন একই নারীর একটি ছবি পাওয়া যায়(আর্কাইভ লিংক)।

২০১৩ সালে রানা প্লাজা ভবন ধ্বসের ওপর প্রকাশিত ফটো প্রতিবেদনের শিরোনামে বলা হয়, “বাংলাদেশের ধ্বসে বহু মানুষ পঙ্গু হয়েছেন”।

ভবন ধ্বসের প্রায় ৭২ ঘণ্টা পর ধ্বংসস্তূপের ভেতর থেকে উদ্ধার করার সময় ডান হাত কেটে ফেলার পর কেভিন ফ্রেয়ারের তোলা এপি-র ছবিটিতে রিকতা(আর্কাইভ লিংক)।

সিন্থআইডিতে ভিডিওটির স্ক্রিনশটের অন্য একটি বিশ্লেষণেও ছবিটেকে “গুগল এআই দিয়ে তৈরি” বলে সনাক্ত করা হয়েছে।

দুটি ভিডিওতেই মাইক্রোফোনের উপর ‘উত্তরবঙ্গ টেলিভিশন’-নামে একটি লোগো দেখা যায়। পেজটিতে জামায়াতে ইসলামীর সমর্থনে এআই দিয়ে তৈরি করা একই ধরনের অনেক কন্টেন্ট রয়েছে(আর্কাইভ লিংক)।

ভিডিওগুলো এআই দিয়ে তৈরি করা হয়েছে বলে ৩ ফেব্রুয়ারি এএফপি-কে নিশ্চিত করেছে উত্তরবঙ্গ টেলিভিশন।

এএফপি বাংলাদেশের রাজনৈতিক অস্থিরতা নিয়ে ছড়ানো অন্যান্য অসত্য দাবি খণ্ডন করেছে এখানে।

কপিরাইট © এএফপি ২০১৭-২০২৬। এই কন্টেন্টের যেকোন বানিজ্যিক ব্যবহারের জন্য অনুমতি নেয়া বাধ্যতামূলক। বিস্তারিত জানতে এখানে ক্লিক করুন।

এমন কোনো কন্টেন্ট আছে যা আপনি এএফপি’কে দিয়ে ফ্যাক্ট চেক করাতে চান?

আমাদের সাথে যোগাযোগ